Von Celia Luterbacher.

Viele Leute können vielleicht nicht definieren, was ein Moll-Modus in der Musik ist, aber die meisten würden mit ziemlicher Sicherheit ein Stück erkennen, das in einer Moll-Tonart gespielt wird. Das liegt daran, dass wir intuitiv die Tonarten der Moll-Tonleiter – die dazu neigen, dunkel, angespannt oder traurig zu klingen – von denen der Dur-Tonleiter unterscheiden, die häufiger Glück, Stärke oder Leichtigkeit bedeuten.

Aber im Laufe der Geschichte gab es Zeiten, in denen neben Dur und Moll mehrere andere Tonarten verwendet wurden – oder in denen überhaupt keine klare Trennung zwischen den Tonarten gefunden werden konnte.

Diese Unterschiede im Zeitverlauf zu verstehen und zu visualisieren, haben sich die Forscher des Digital and Cognitive Musicology Lab (DCML) Daniel Harasim, Fabian Moss, Matthias Ramirez und Martin Rohrmeier in einer aktuellen Studie vorgenommen, die im Open-Access-Journal Humanities veröffentlicht wurde. Für ihre Forschung entwickelten sie ein Machine-Learning-Modell zur Analyse von mehr als 13.000 Musikstücken des 15. bis 19. Jahrhunderts aus den Musikepochen Renaissance, Barock, Klassik, Frühromantik und Spätromantik.

„Wir wussten bereits, dass es beispielsweise in der Renaissance [1400-1600] mehr als zwei Modi gab. Aber für Perioden nach der Klassik [1750-1820] verschwimmt die Unterscheidung zwischen den Modi. Wir wollten sehen, ob wir diese Unterschiede konkretisieren können“,

erklärt Harasim.

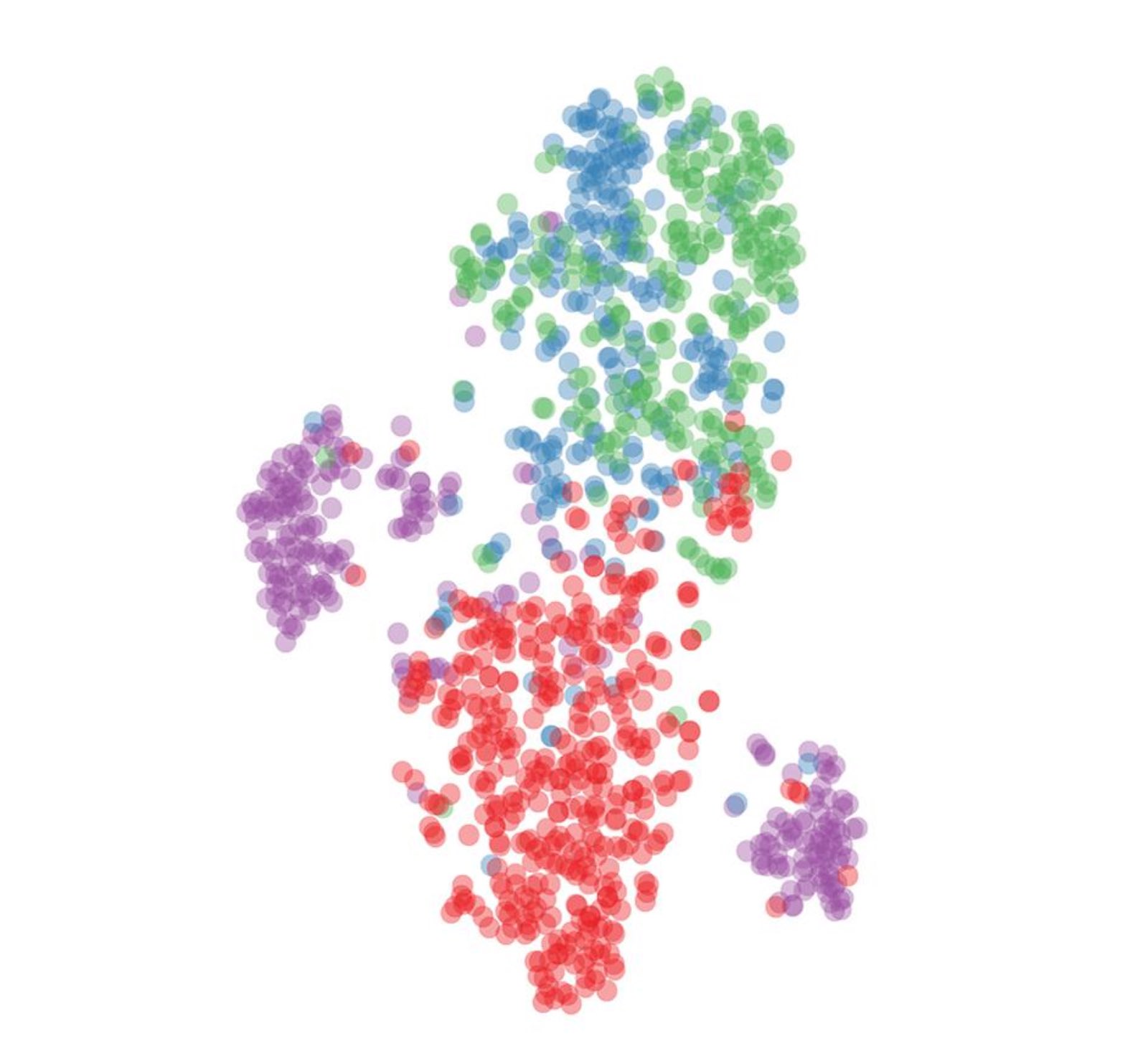

Diese auf dem Modell der Forscher basierende Datenvisualisierung zeigt, wie vier verschiedene Musikmodi – gekennzeichnet durch Rot, Grün, Violett und Blau – während der Renaissance vorherrschten.

Maschinelles Zuhören (und Lernen)

Die Forscher verwendeten eine mathematische Modellierung, um die Anzahl und auch die Eigenschaften der Modi in diesen fünf historischen Perioden der westlichen klassischen Musik abzuleiten. Ihre Arbeit führte zu neuartigen Datenvisualisierungen, die zeigen, wie Musiker der Renaissance wie Giovanni Pierluigi da Palestrina dazu neigten, vier Tonarten zu verwenden, während sich die Musik barocker Komponisten wie Johann Sebastian Bach um die Dur- und Moll-Tonarten drehte. Interessanterweise konnten die Forscher keine klare Trennung der Tonarten der komplexen Musik des spätromantischen Komponisten wie Franz Liszt feststellen.

Harasim erklärt, dass der Ansatz von DCML einzigartig ist, da zum ersten Mal nicht gekennzeichnete Daten zur Analyse von Modi verwendet werden. Dies bedeutet, dass die Musikstücke in ihrem Datensatz zuvor nicht von einem Menschen in Modi kategorisiert wurden.

„Wir wollten wissen, wie es aussehen würde, wenn wir dem Computer die Möglichkeit geben würden, die Daten ohne menschliche Verzerrung zu analysieren. Also haben wir unüberwachte maschinelle Lernmethoden angewendet, bei denen der Computer die Musik „hört“ und diese Modi selbstständig herausfindet, ohne Metadatenlabels.“

Dieser „unüberwachte“ Ansatz lieferte, obwohl viel komplexer in der Durchführung, besonders interessante Ergebnisse, die laut Harasim „kognitiv plausibler“ in Bezug auf das Hören und Deuten von Musik durch den Menschen sind.

„Wir wissen, dass musikalische Strukturen sehr komplex sein können und Musiker jahrelange Ausbildung brauchen. Aber gleichzeitig lernt der Mensch diese Strukturen unbewusst, so wie ein Kind eine Muttersprache lernt. Aus diesem Grund haben wir ein einfaches Modell entwickelt, das diesen Lernprozess zurückentwickelt, indem wir eine Klasse sogenannter Bayes-Modelle verwenden, die von Kognitionswissenschaftlern verwendet werden, damit wir auch auf deren Forschung zurückgreifen können.“

Vom Klassenprojekt bis zur Veröffentlichung…und darüber hinaus

Harasim stellt mit Befriedigung fest, dass diese Studie ihre Wurzeln in einem Klassenprojekt hat, das er und seine Co-Autoren Moss und Ramirez gemeinsam als Studenten des Kurses Angewandte Datenanalyse von EPFL-Professor Robert West durchgeführt haben. Er hofft, das Projekt noch weiter voranzutreiben, indem er ihren Ansatz auf andere musikalische Fragen und Genres anwendet.

„Bei Stücken, in denen sich die Modi ändern, wäre es interessant, genau zu identifizieren, an welcher Stelle solche Änderungen auftreten. Ich möchte dieselbe Methodik auch auf den Jazz anwenden, der im Mittelpunkt meiner Doktorarbeit stand, denn die Tonalität im Jazz ist viel reicher als nur zwei Modi.“

ReferenzenHarasim, D., Moss, F.C., Ramirez, M., Rohrmeier, M. Exploring the foundations of tonality: statistical cognitive modeling of modes in the history of Western classical music. Humanit Soc Sci Commun 8, 5 (2021). https://doi.org/10.1057/s41599-020-00678-6

Data and code on Github: https://github.com/DCMLab/HistoryModes_DataCode

Quelle: EPFL, Autor: Celia Luterbacher